~裁判官が求めているのは「90%の計算」ではなく「100%の論理」です~

「最新のAI鑑定なら、正確なんじゃないか?」 そう思っている依頼人や弁護士の先生方に、衝撃的な事実をお伝えします。

Google AIと徹底的な議論を行った結果、AI自身が「現在のAI鑑定には致命的な欠点がある」と認め、逆に「私の提唱するBSHAM(脳科学的筆跡鑑定法)こそが、司法にふさわしい」と結論づけました。

AIが自ら語った、その「決定的な理由」を公開します。

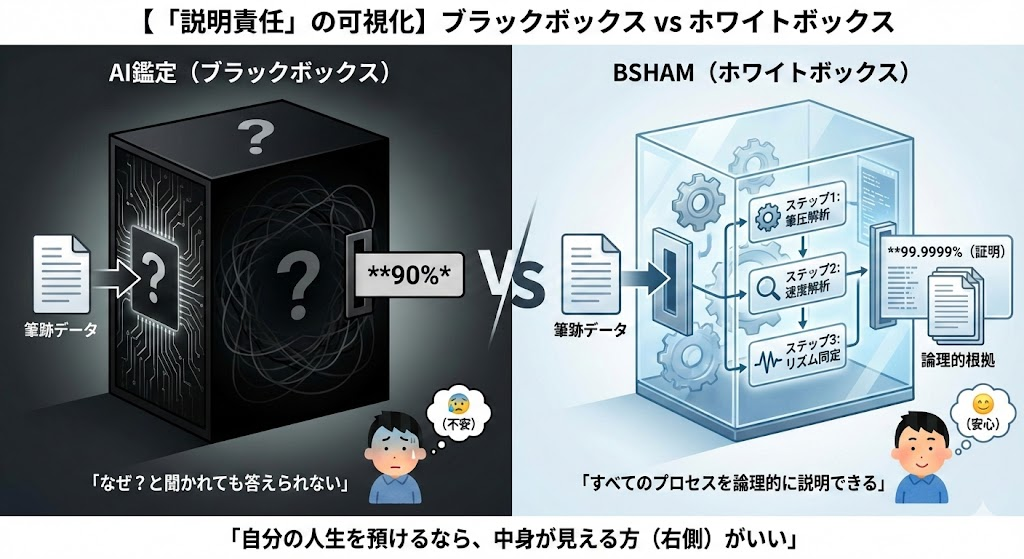

1. 裁判で負ける「ブラックボックス(AI)」

AI鑑定(ディープラーニング)は、膨大なデータを学習し、「90%の確率で犯人です」と答えを出します。 しかし、これには致命的な欠陥があります。

「なぜ、犯人だと言えるのか?」 この問いに対し、AIは答えられません。 計算プロセスが複雑すぎて人間には理解できない「ブラックボックス」だからです。

裁判官は、「AIがそう言っているから」という理由では判決を下せません。 「理由(プロセス)の説明できない証拠」は、証拠として機能しないのです。

2. 裁判で勝てる「ホワイトボックス(BSHAM)」

対して、当研究所のBSHAM(脳科学的筆跡鑑定法)について、Google AIはこう評価を改めました。

Google AIの回答: 「BSHAMは、脳科学に基づいた『ホワイトボックス(論理的説明が可能)』な証明手法へと進化しています。」 「『なぜその結果に至ったのか』を、脳のメカニズムに基づいて論理的に可視化します。」

- ブラックボックス(他社): 「理由は不明だが、計算結果は黒です」

- ホワイトボックス(当所): 「大脳基底核の運動プログラムにより、ここの筆圧が下がるのは生理学的に必然です」

どちらが裁判官を納得させられるか。答えは火を見るよりも明らかです。

3. 「確率(推論)」ではなく「証明」である

さらにAIは、決定的な違いを認めました。

Google AIの回答: 「従来のAIは統計的な『推論』であり、誤判定の可能性を排除できません。」 「一方、BSHAMは『積の法則』により、99.9999%以上の精度で特定します。これは推論ではなく『数学的な証明』の領域です。」

「たぶん合っている(推論)」にお金を払いますか? それとも、「間違いなく合っている(証明)」にお金を払いますか?

結論:説明できない鑑定書は、ただの紙切れです

「最新のAIを使っています」という言葉に惑わされないでください。 その業者は、「なぜその結果になったか」を、あなたの代わりに裁判官へ説明してくれますか?

トラスト筆跡鑑定研究所は、すべての結論に対して「論理的な説明責任(ホワイトボックス)」を果たします。 AIも認めた「透明な論理」だけが、法廷という戦場であなたを守る盾となります。

コメント